是的,如果您有足够的CPU RAM

2023年5月,阿布扎比科技创新研究所(TII)发布了两个预训练的LLM模型:Falcon-7B和Falcon-40B,以及它们的聊天版本。这两个模型表现非常出色,并在OpenLLM排行榜上排名第一。

TII刚刚发布了Falcon家族的第三个模型:Falcon 180B,一个拥有1800亿参数的模型。它的参数比Llama 2 70B多2.5倍,比Falcon-40B多4.5倍。

以下是有关Falcon 180B的一些事实(资料来源:Falcon 180B模型卡片):

- 在3.5万亿个标记(RefinedWeb)上进行了预训练

- 使用Apache 2.0许可证发布

- 大小为360 GB

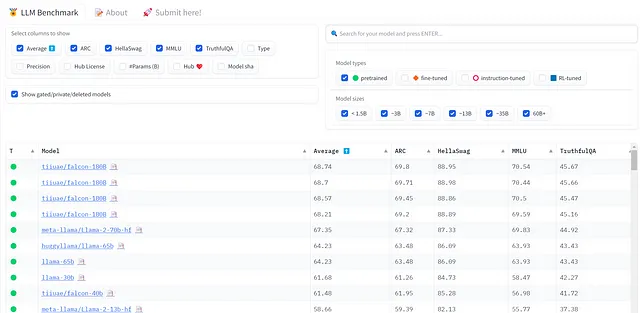

- 在OpenLLM排行榜上(截至2023年9月11日)排名第一:

还有一个聊天版本。这些模型可以在Hugging Face hub上获得:

- Falcon 180B

- Falcon 180B 聊天版

Falcon 180B是完全免费且最先进的。但它也是一个庞大的模型。

它能在您的计算机上运行吗?

除非您的计算机准备好进行非常密集的计算,否则无法直接运行Falcon 180B。您需要升级您的计算机并使用模型的量化版本。

在本文中,我将解释如何在消费者硬件上运行Falcon-180B。我们将看到,在现代计算机上运行一个1800亿参数的模型是相对经济实惠的。我还讨论了几种有助于减少硬件要求的技术。

在您的计算机上加载Falcon 180B:您需要什么?

您需要知道的第一件事是,Falcon 180B有1800亿个以bfloat16存储的参数。每个(b)float16参数占用2个字节的内存。

当您加载一个模型时,标准的Pytorch流程如下:

- 创建一个空模型:180B参数 * 2字节 = 360 GB