大型语言模型(LLMs)的炒作不断增长,越来越多的公司发布工具,使人们的生活更加轻松。那么,到底有哪些工具能够帮助构建LLMs世界呢?其中之一就是Flowise AI。

Flowise AI是什么?

Flowise AI是一个开源的UI可视化工具,用于帮助开发LangChain应用。在详细了解Flowise AI之前,让我们先快速定义一下LangChain。LangChain是一个框架/Python库,它帮助您利用LLMs构建自己的自定义NLP应用程序。

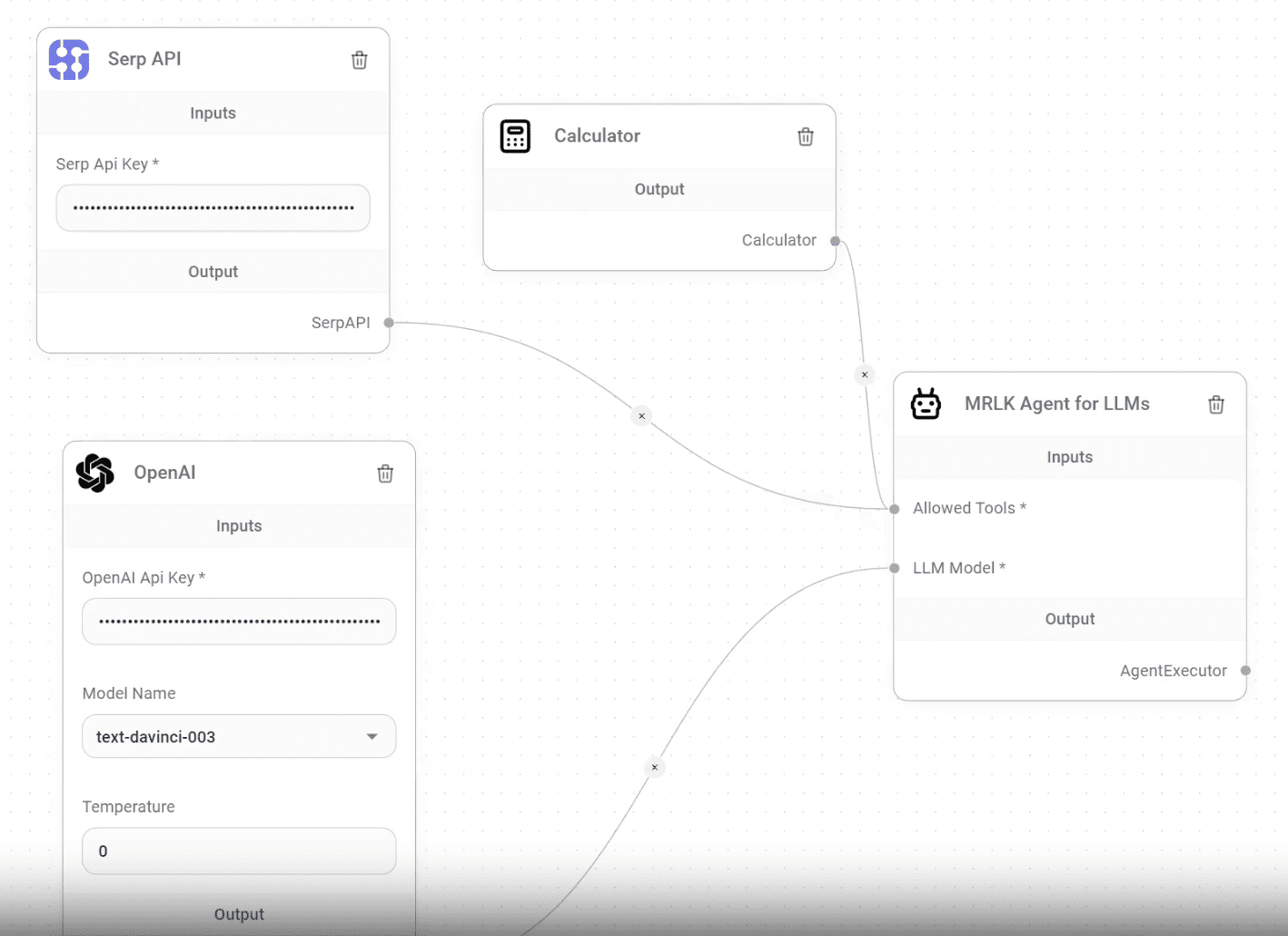

Flowise使用LangChain作为其代理执行器,Chroma作为其向量存储器,OpenAI用于嵌入,HuggingFace的推理模型,GitHub作为文档加载器,以及Serp用于查询API。其图形用户界面在构建基于LangChain.js的基于LLM的应用程序方面非常有帮助。

那么,它有什么使它如此简单和有帮助呢?就是拖放工具。每个人都喜欢拖放,尤其是当您自定义NLP应用程序时。更大的优点是它不需要任何编码经验!

我可以用Flowise AI构建什么?

您可以使用Flowise AI构建多种应用程序,例如:

- 聊天机器人

- 虚拟助手

- 数据分析工具

- 教育工具

- 游戏

- 艺术

为什么我应该使用Flowise AI?

- 简单易用:拖放工具使构建自己的LLM流程变得简单。

- 无需编码技能:对于行业新人和没有开发人员的组织来说非常有用。

- 开源:免费使用和修改,可以根据自己的需求进行定制。

- 强大:该工具可以用于开发各种LLM应用程序。

- 社区支持:Flowise得到了一个支持性的开发社区的支持,可以帮助您充分利用Flowise。

Flowise AI安装

那么,我如何安装这个简单的可定制的NLP拖放工具呢?有3种不同的方式可以安装Flowise AI。让我们逐个进行说明。

快速安装

- 首先,您需要下载并安装NodeJS >= 18.15.0。

- 安装完成后,您需要安装Flowise

npm install -g flowise

- 接下来,您需要启动Flowise

npx flowise start

您需要输入用户名和密码:

npx flowise start --FLOWISE_USERNAME=user --FLOWISE_PASSWORD=1234

- 完成后,您可以通过打开以下网址在网页上打开:

http://localhost:3000

如果您喜欢使用Docker,请继续下一部分。

Docker

Docker Compose

- 首先,您需要进入项目的根目录下的docker文件夹

- 然后,您需要创建.env文件并指定端口(请参考.env.example)

- 然后,您需要执行:docker-compose up -d

- 接下来,您需要打开http://localhost:3000

- 您可以通过docker-compose stop将容器停止

Docker镜像

- 首先,您需要在本地构建镜像:

docker build --no-cache -t flowise .

- 然后,您需要运行镜像:

docker run -d --name flowise -p 3000:3000 flowise

- 要停止镜像,您需要执行以下操作:

docker stop flowise

开发者本地设置

- 首先,您需要安装Yarn v1:

npm i -g yarn

- 然后,您需要克隆代码库:

git clone https://github.com/FlowiseAI/Flowise.git

- 进入代码库文件夹:

cd Flowise

- 确保安装所有模型的依赖项:

yarn install

- 然后,您需要构建所有代码:

yarn build

- 然后,您可以启动应用程序:

yarn start

- 您可以在以下网址访问应用程序:

http://localhost:3000

- 要进行开发构建,请使用:

yarn dev

总结

所以,如果您是一个对技术行业完全陌生且没有编码经验的人,或者您的团队缺少开发人员的组织 – Flowise AI是您的最佳选择。如果有任何当前或以前使用Flowise的用户阅读到这篇文章,请在评论中告诉我们您的经验!Nisha Arya是一名数据科学家,自由技术作家和VoAGI的社区经理。她特别感兴趣为数据科学提供职业建议、教程和理论知识。她还希望探索人工智能对人类寿命的不同方式的益处。作为一个热心的学习者,她希望扩展自己的技术知识和写作能力,同时帮助指导他人。