什么是它以及如何处理它

在大数据领域,Apache Spark因其处理海量数据的能力而备受青睐。作为全球头号大数据处理引擎,学习使用这个工具是任何大数据专业人士技能集的基石。而在这条道路上的一个重要步骤就是理解Spark的内存管理系统和“磁盘溢出”的挑战。

磁盘溢出是指当Spark无法将数据放入内存中时,需要将其存储在磁盘上。Spark的一个主要优势是其内存处理能力,比使用磁盘驱动器快得多。因此,构建需要溢出到磁盘的应用程序有些违背Spark的初衷。

磁盘溢出会导致一系列不良后果,因此学习如何处理它是Spark开发人员的重要技能。本文旨在帮助读者了解磁盘溢出的定义、原因、后果以及如何解决它。通过使用Spark的内置用户界面,我们将学习如何识别磁盘溢出的迹象并理解其相关指标。最后,我们将探讨一些可行的策略来减轻磁盘溢出,例如有效的数据分区、适当的缓存和动态群集调整。

Spark中的内存管理

在深入研究磁盘溢出之前,了解Spark中的内存管理如何工作是有用的,因为这在磁盘溢出的发生和处理中起着关键作用。

Spark被设计为一种内存数据处理引擎,这意味着它主要使用RAM来存储和操作数据,而不是依赖磁盘存储。这种内存计算能力是使Spark快速和高效的关键特性之一。

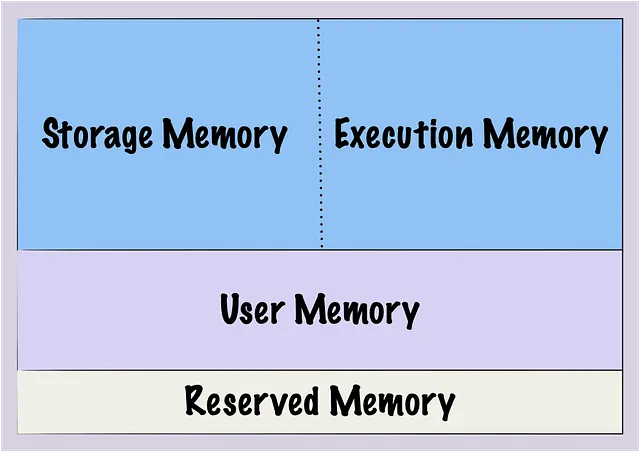

Spark有一定的内存分配给其操作,并且这些内存被分为不同的部分,组成了所谓的统一内存: