通过使用开源LLMs和GPU租赁解锁大型计算项目的成本效益。

介绍

在大型语言模型(LLMs)的世界中,计算成本可能是一个重要的障碍,特别是对于大规模项目。我最近开始了一个需要运行400万个提示的项目,平均输入长度为1000个标记,平均输出长度为200个标记。这几乎是50亿个标记!按照每个标记付费的传统方法,就像GPT-3.5和GPT-4等模型常见的那样,将导致一笔可观的费用。然而,我发现通过利用开源LLMs,我可以将定价模型转变为按计算时间付费,从而节省大量费用。本文将详细介绍我采取的方法,并对每种方法进行比较和对比。请注意,虽然我分享了我的定价经验,但这些可能会随时变化,并且可能因您所在地区和具体情况而异。这里的关键是,通过利用开源LLMs并按小时租用GPU,可以实现潜在的成本节约,而不是特定的报价价格。如果您计划为您的项目使用我的推荐解决方案,在本文末尾我留下了一些附属链接。

ChatGPT API

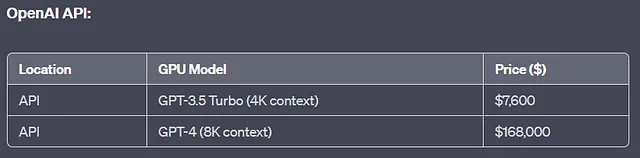

我对一小部分提示输入数据使用了GPT-3.5和GPT-4进行了初步测试。两个模型都表现出了可称赞的性能,但GPT-4在大多数情况下始终优于GPT-3.5。为了让您了解成本,使用Open AI API运行所有400万个提示的费用大致如下:

虽然GPT-4确实提供了一些性能优势,但成本与其为我的输出增加的增量性能相比过高。相反,GPT-3.5 Turbo虽然更实惠,但在性能方面表现不佳,在我的提示输入中会出现明显的错误(2-3%)。鉴于这些因素,我不准备在一个……